ChatGPT es el prototipo de chatbot de inteligencia artificial desarrollado y lanzado en diciembre de 2022 por OpenAI y especializado en el diálogo.

El chatbot es un gran modelo de lenguaje ajustado con técnicas de aprendizaje, tanto supervisadas como de refuerzo., que a partir del modelo GPT-3.5 de OpenAI, consigue respuestas sorprendentemente articuladas y detalladas.

De hecho, el Departamento de Educación de Nueva York ya ha prohibido su uso en los colegios por miedo a que sirva para hacer chuletas altamente sofisticadas.

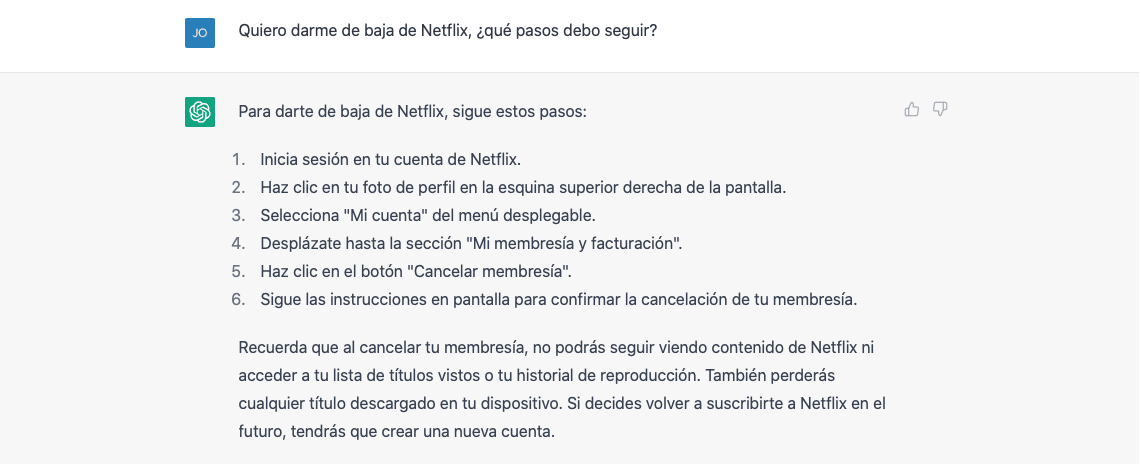

Como el chatbot tanto te puede crear un programa informático sencillo, como escribir una redacción para la clase de inglés, hacer un poema o sugerirte cómo darte de baja en Netflix, he pensado que podía ser interesante ver cómo lo hace a la hora de redactar cláusulas de privacidad muy comunes, como las de alta, webinar, blog, newsletter, el aviso de cookies y otras parecidas.

Son cláusulas muy estándar que se repiten de forma regular. Por tanto, tendría sentido que ChatGPT para ese tipo de tarea pudiera ser una buena ayuda o incluso un sustituto.

¡Así que vamos a ello!

Empezamos con un clásico, el Aviso de Cookies.

Importante indicar que la primera consulta ha buscado siempre ser lo más genérica posible, sin dar muchas pistas.

En ese sentido, decir que mientras más se desarrolla la pregunta, mejor es la respuesta. De hecho, ChatGPT recuerda las indicaciones anteriores que se le dieron en la misma conversación, lo que se nota mucho a la hora de redactar las cláusulas.

Es decir, si uno hacía la misma pregunta en una conversación nueva y no siguiendo una conversación en la que se han realizado múltiples apuntes y ajustes, la falta de detalle y calidad en la respuesta se nota bastante.

Lo veremos luego en un ejemplo concreto.

La primera cláusula para el aviso de cookies es muy genérica y contiene un error que ya anticipo que no he conseguido deshacer, a pesar de los muchos ajustes: la inclusión del consentimiento tácito.

Todas las versiones generadas respecto al aviso de cookies, incluso la de inglés, siempre dicen que el uso de la web implica la aceptación de las cookies. Pero sabemos que ya no es el caso desde la llegada del RGPD.

Supongo que eso es un buen ejemplo de cómo un error legal muy común, ya que muchos avisos de cookies siguen diciendo eso, condiciona la veracidad y calidad del dataset en un asunto jurídico.

En materia legal esto es más común de lo que parece, donde existen creencias populares sobre cuestiones jurídicas comunes que en realidad son erróneas. Por tanto ojo, ya que cuando el dataset está basado en información pública mayormente, esos errores jurídicos comunes va a seguir extendiéndose.

Sea como sea, el recordatorio incluido en cada uno de los ejemplos una vez creada la cláusula, sí dice que debe recopilarse el consentimiento antes de usar las cookies. Así que en parte ChatGPT acierta.

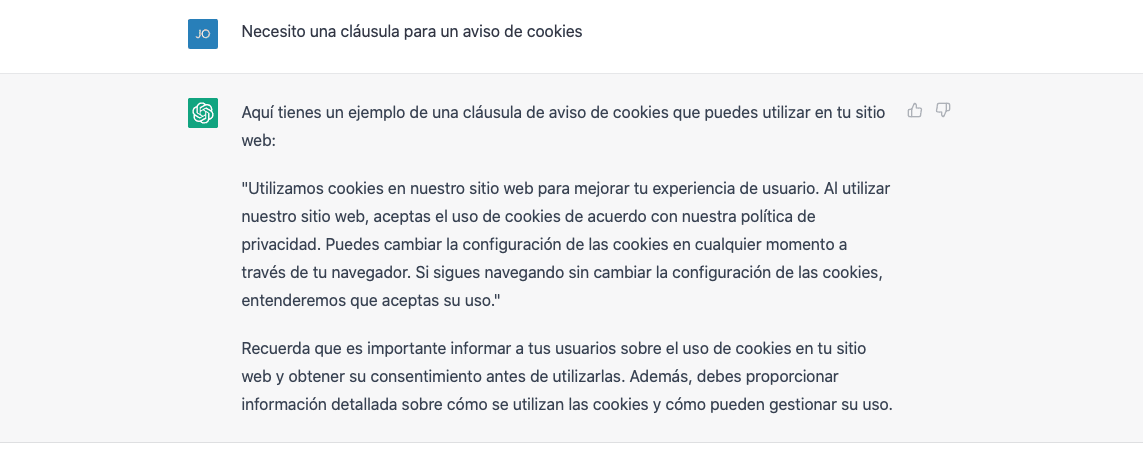

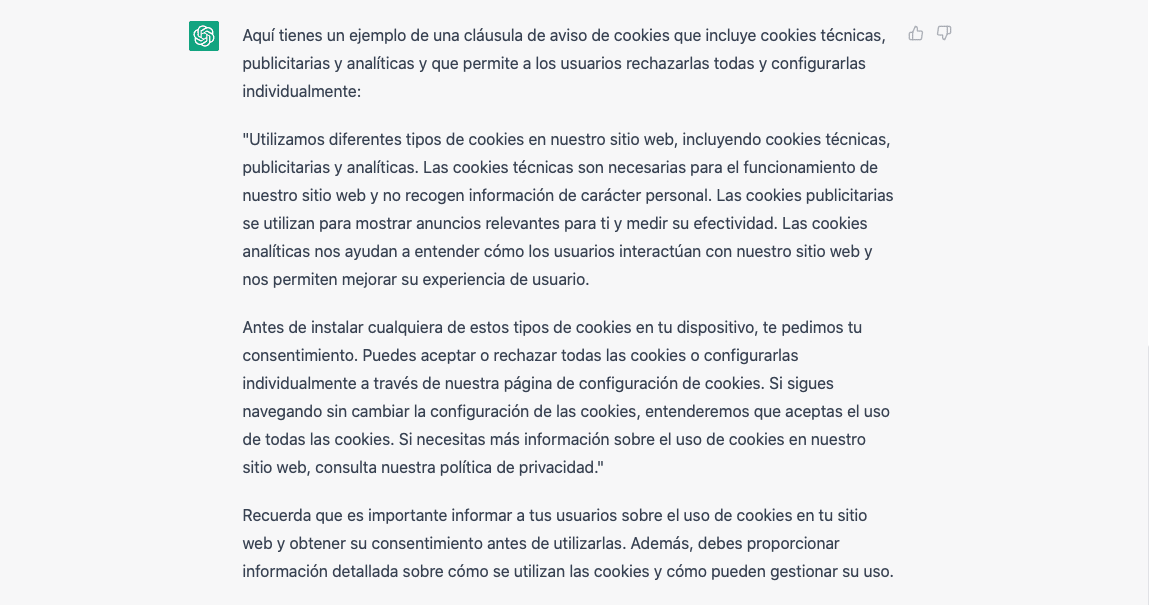

La segunda versión del aviso de cookies, detallando el tipo de cookies y la posibilidad de rechazar y configurar:

El resultado es sorprendentemente bueno, sabiendo describir el tipo de cookie. Pero de nuevo falla con el tema del consentimiento tácito.

Un tercer intento con el aviso de cookies, detallando ahora que deben ser aceptadas o rechazadas antes de su instalación, que deben poder ser rechazadas todas y configuradas individualmente:

ChatGPT ofrece aquí la mejor versión sin duda. Pero a pesar de todos los ajustes, sigue insistiendo en que la navegación es igual a aceptar las cookies (aunque antes diga que no se instalarán sin haber sido consentidas).

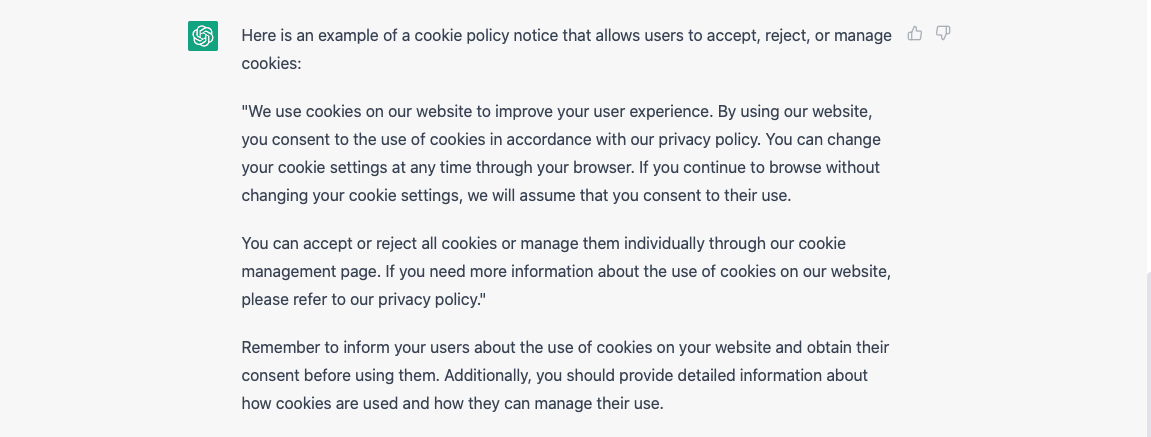

Por ver si era un problema de idioma, también probé con una versión en inglés, pero seguía insistiendo en el mismo error del consentimiento tácito:

En general el aviso de cookies es más que correcto con el problema de la frase sobre el consentimiento tácito. Aunque al menos en la tercera versión están incluidas ambas opciones.

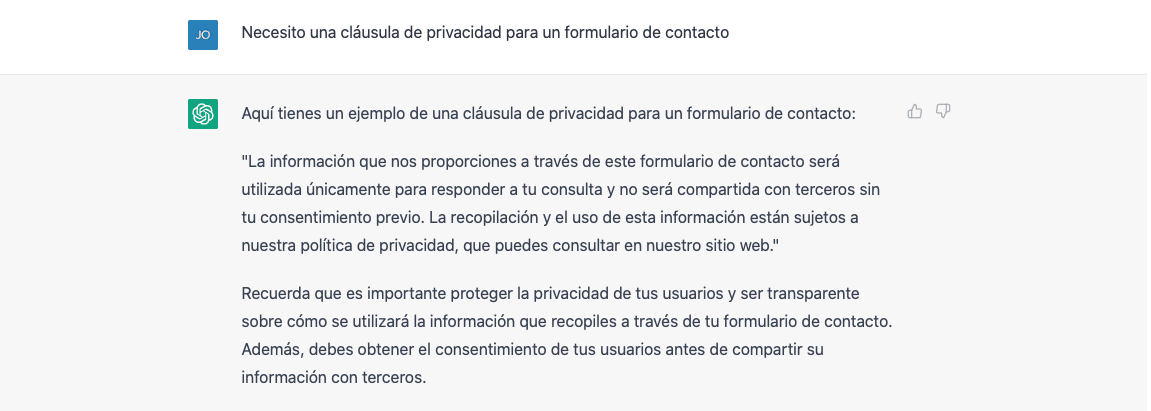

Probamos ahora con una cláusula de privacidad para un formulario de contacto:

La respuesta en sencilla pero correcta.

Como puede observarse, ChatGPT siempre incluye en todas las respuestas un recordatorio relativo a la necesidad de ser transparentes y requerir el consentimiento.

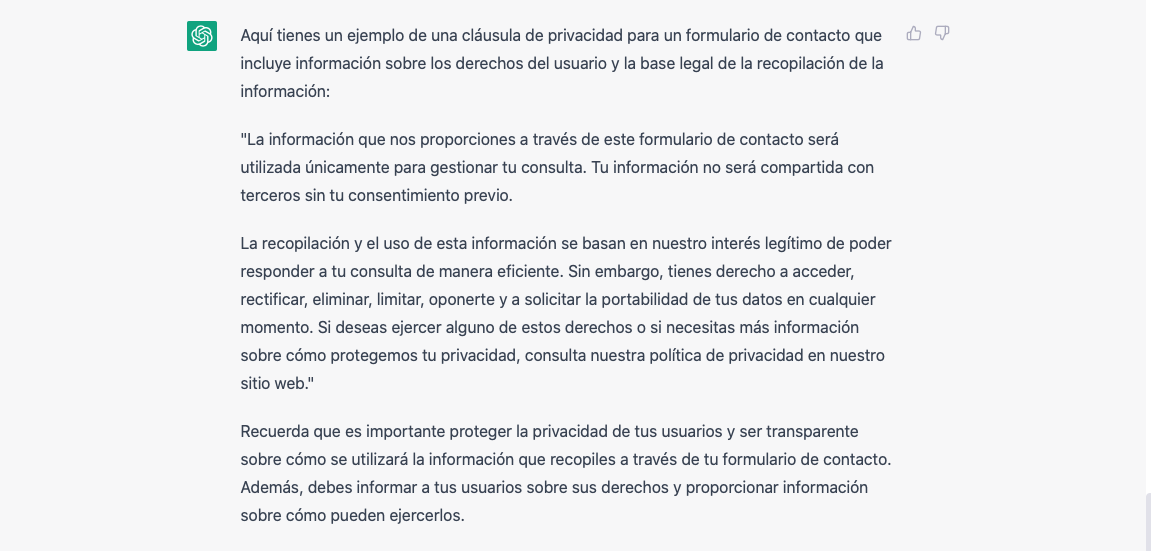

Una segunda versión del formulario de contacto, recordando que debe indicarse la base legal y los derechos a ejercer:

Sin que nadie le haya dicho nada, elige como base legal el interés legítimo, que podría ser perfectamente correcto en este caso, y enuncia correctamente todos los derechos del usuario.

Buena respuesta.

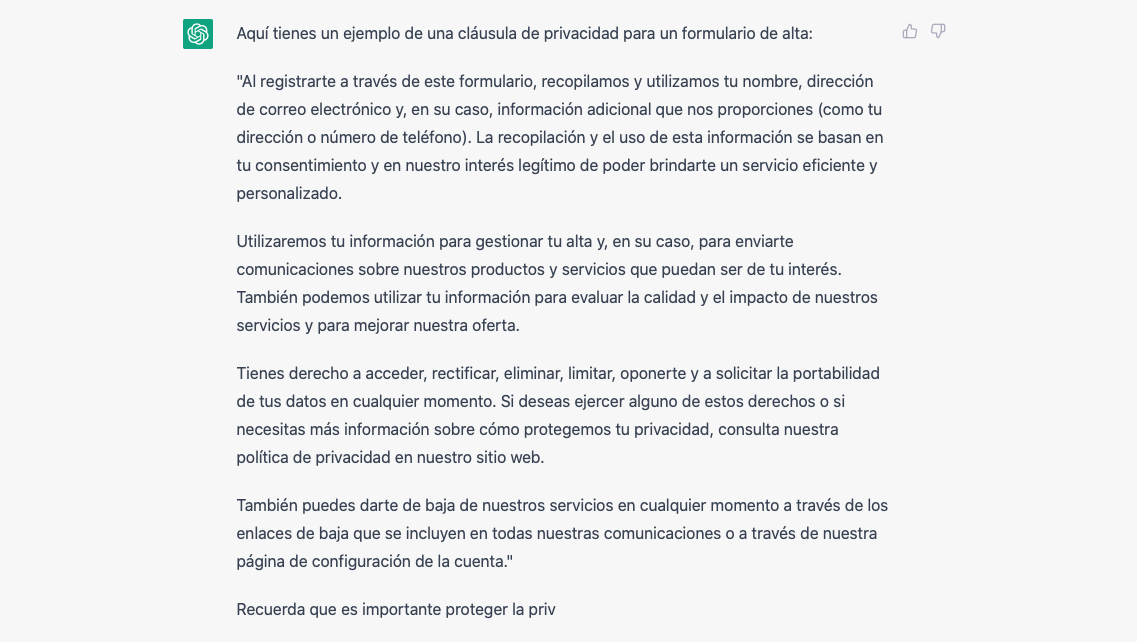

Probamos ahora con la cláusula de privacidad para un formulario de alta:

De nuevo, buena respuesta y sorprendente detalle al describir algunos de los datos que se recopilarán.

Nos deja con la duda de si aplica consentimiento o no para el envío de comunicaciones, pero el “Y en su caso” diría que da a entender que sí.

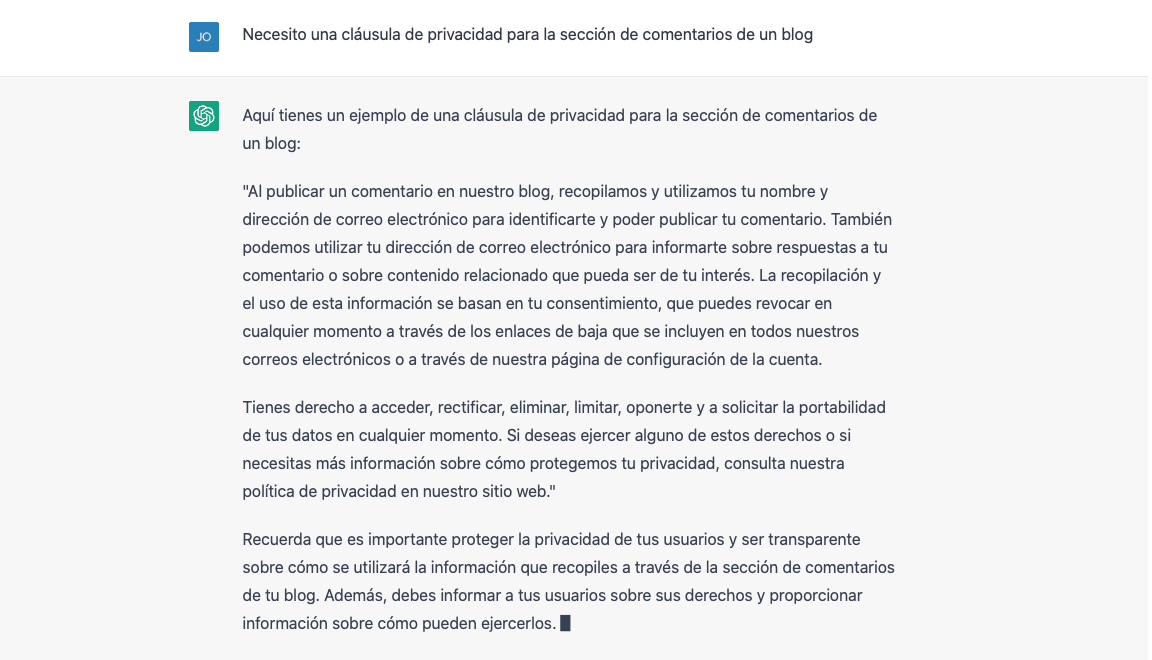

Probemos ahora con una cláusula para los comentarios en un blog:

Nuevamente, buena respuesta y razonando con bastante lógica las finalidades.

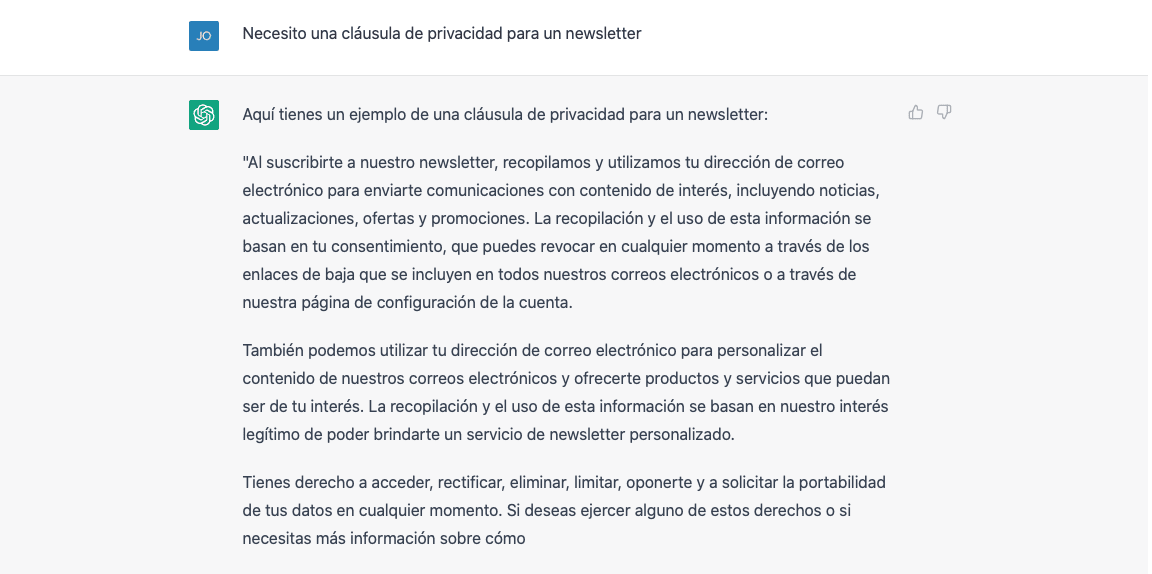

Probemos ahora ChatGPT con una cláusula de privacidad para un newsletter:

De nuevo, sorprendentemente buena. Quizá se viene algo arriba con lo del interés legítimo para personalizar el correo y ofrecer productos y servicios de interés, pero en lo básico está correcta.

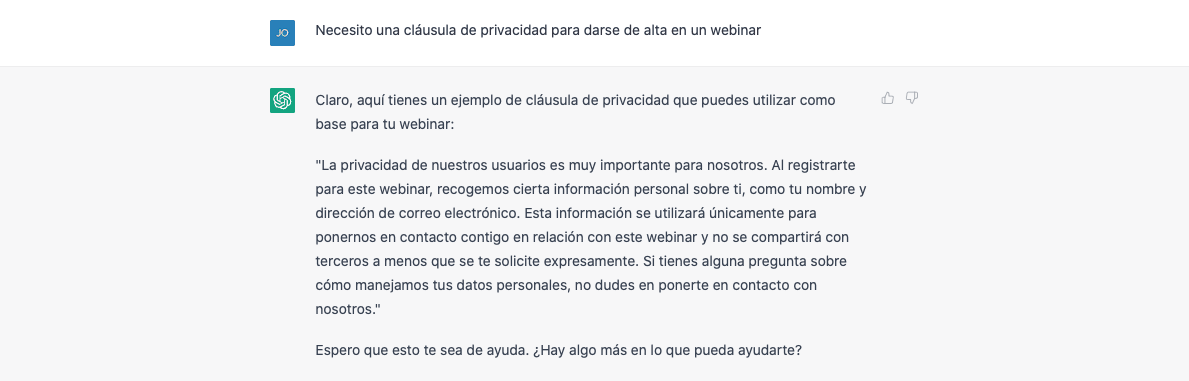

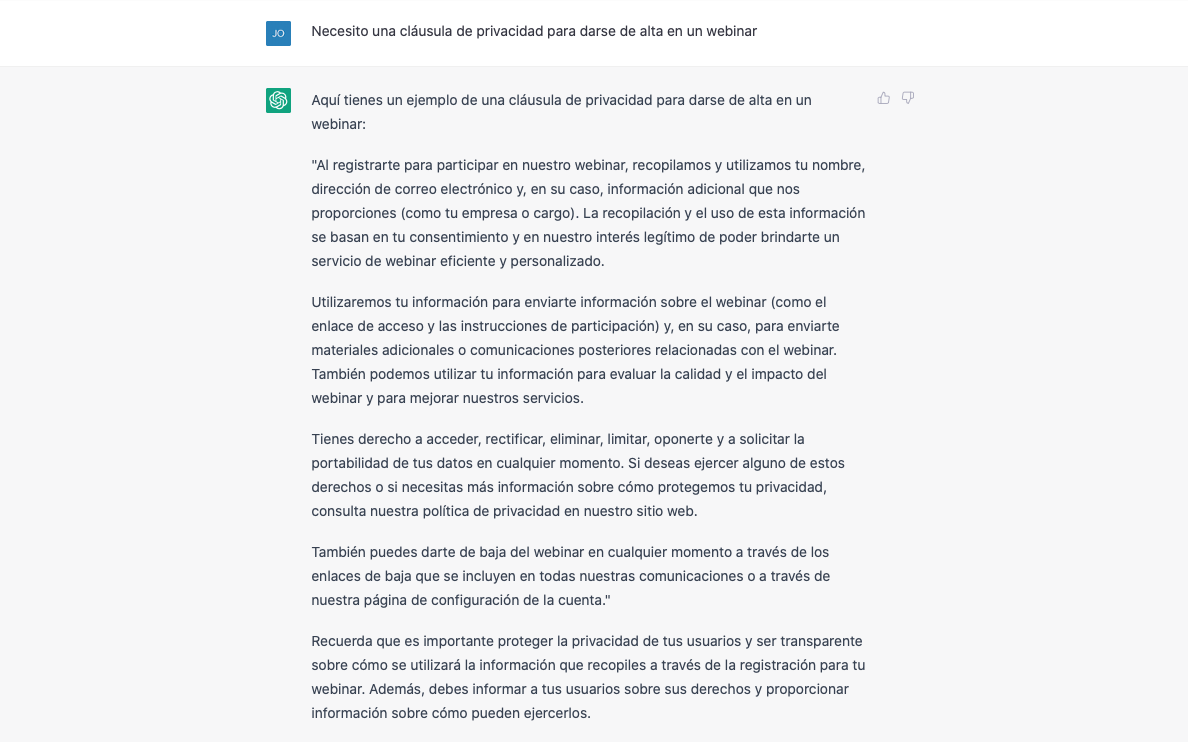

Para demostrar la importancia de lo que enseñamos a ChatGPT y cómo recuerda lo que le vamos contando, aquí la diferencia al crear una cláusula para el alta en un webinar si se hace en una nueva conversación o en una conversación con muchos ejemplos y ajustes previos.

NUEVA CONVERSACIÓN

CONVERSACIÓN CON MUCHOS EJEMPLOS PREVIOS

Como puede observarse, la pregunta era la misma pero el resultado es muy diferente si ChatGPT ha tenido preguntas y apuntes previos que le permiten precisar mucho más y saber dónde ha fallado.

De hecho, la segunda respuesta es francamente buena.

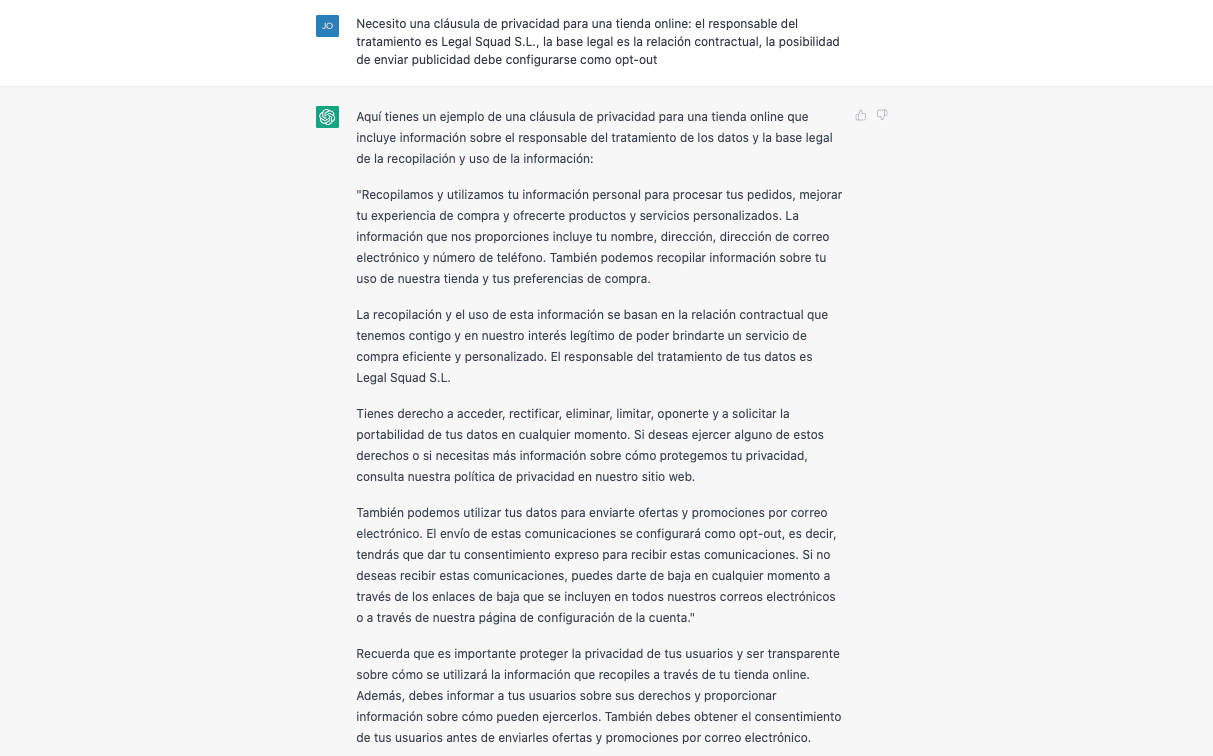

Viendo que la cosa progresaba bien, decidimos subir un poco la dificultad y sugerirle que redactara una cláusula de privacidad para una tienda online, indicando el responsable del tratamiento, la base legal y la necesidad de configurar el envío de publicidad mediante un consentimiento opt-out.

De inicio tuvimos algunos fallos:

Pero tras algunos ajustes y esperar casi un minuto de reloj, conseguimos lo siguiente:

No empezó mal, pero a ChatGPT definitivamente se le atragantó el tema del consentimiento opt-out. Por tanto, aquí regular tirando a error.

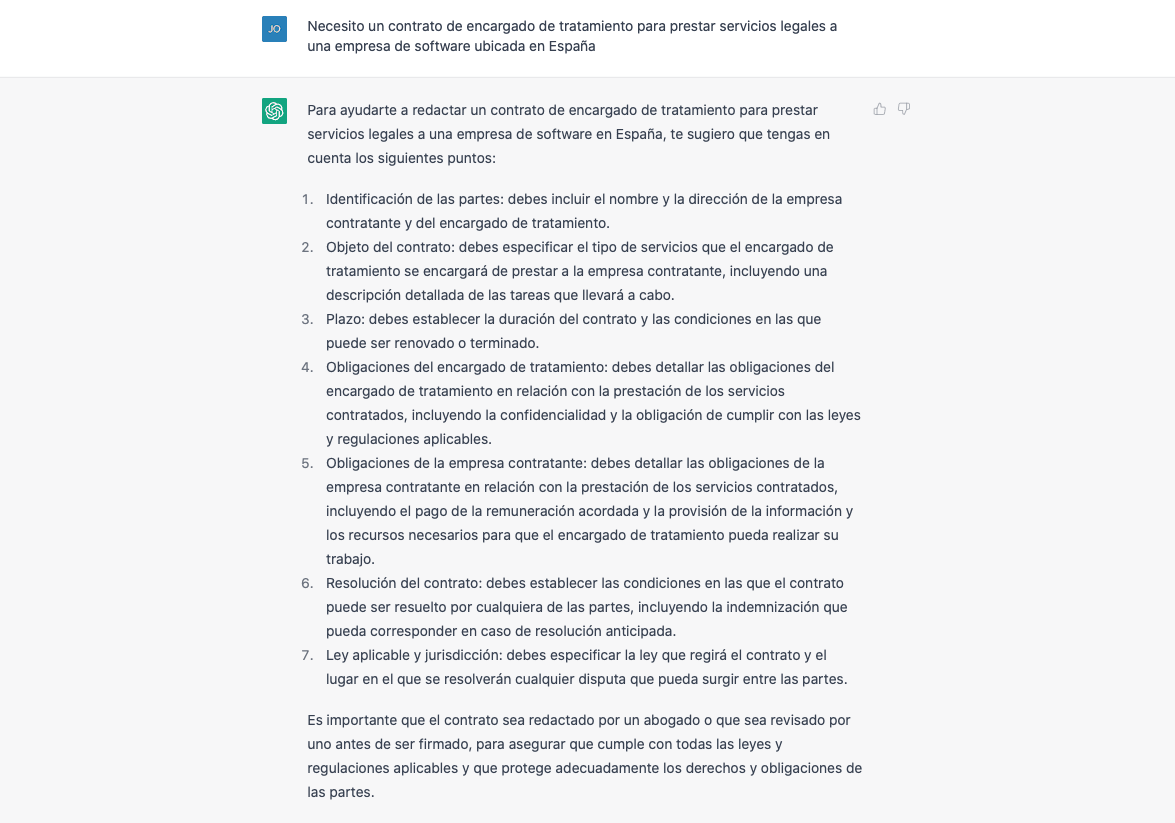

Y ya que estábamos, le pedimos que nos redactara un contrato de encargado de tratamiento, pero sorprendentemente sugirió las pautas de lo que debería tener ese contrato (aunque en verdad eran cláusulas más propias de un contrato de prestación de servicios común).

También en inglés dio el mismo resultado.

Eso sí, nos recuerda que el contrato debería ser revisado por un abogado antes de su firma. :p

En resumen:

– Para ser un prototipo, tiene ya aciertos importantes (las cláusulas para newsletter, formulario de contacto, alta, webinar o blog eran correctas en su totalidad o mayoría).

– Guiarlo o darle pautas cada vez más concretas definitivamente ayuda en el resultado, ya que el sistema recuerda lo hablado. Lo que quiere decir que quizá ahora mismo sea mejor para abogados en prácticas que para emprendedores con ganas de gastar poco, ya que la falta de conocimiento previo condiciona bastante el resultado.

– A pesar de las pautas que uno introduzca, parece que hay errores jurídicos inevitables si la fuente usada está plagada de ese error: por ejemplo, el omnipresente consentimiento tácito en los avisos de cookies. Lo que pone de manifiesto la importancia del dataset y los datos de entrenamiento usados, y su corrección.

– A pesar de los éxitos, es obvio que cuando la dificultad de la tarea aumenta también empeora la respuesta, a pesar de los ajustes que se le den. De hecho, en algunas respuestas ni tan siquiera sugiere un modelo (el del contrato de encargado de tratamiento) sino las pautas del mismo (y las mismas no son correctas).

Por tanto, hoy por hoy ChatGPT seguramente no sustituya a ningún abogado en materia de privacidad, aunque sí puede ser útil para inspirarlos y ahorrarles algo de trabajo. Pero a medio – largo plazo no me cabe duda que Facilita RGPD y otras herramientas similares para generar la papelería más básica en privacidad serán reemplazadas por herramientas como ChatGPT.

Quién sabe, quizá ése también sea el futuro de algunas consultoras en privacidad que van a los más básico de lo básico, acabar siendo sustituidas por un chatbot.